Eseguire il rilevamento di anomalie con un modello di previsione multivariato di serie temporali

Per fornire feedback o richiedere assistenza per questa funzionalità, invia un'email all'indirizzo [email protected].

Questo tutorial ti mostra come svolgere le attività seguenti:

- Crea un

modello di previsione di

ARIMA_PLUS_XREGserie temporale. - Rileva le anomalie nei dati delle serie temporali eseguendo la funzione

ML.DETECT_ANOMALIESsul modello.

Questo tutorial utilizza le seguenti tabelle del set di dati epa_historical_air_quality pubblico, che contiene informazioni giornaliere su PM 2, 5, temperatura e velocità del vento raccolte da più città degli Stati Uniti:

epa_historical_air_quality.pm25_nonfrm_daily_summaryepa_historical_air_quality.wind_daily_summaryepa_historical_air_quality.temperature_daily_summary

Autorizzazioni obbligatorie

- Per creare il set di dati, devi disporre dell'autorizzazione IAM

bigquery.datasets.create. Per creare la risorsa di connessione, devi disporre delle seguenti autorizzazioni:

bigquery.connections.createbigquery.connections.get

Per creare il modello, devi disporre delle seguenti autorizzazioni:

bigquery.jobs.createbigquery.models.createbigquery.models.getDatabigquery.models.updateDatabigquery.connections.delegate

Per eseguire l'inferenza, devi disporre delle seguenti autorizzazioni:

bigquery.models.getDatabigquery.jobs.create

Per ulteriori informazioni sui ruoli e sulle autorizzazioni IAM in BigQuery, consulta Introduzione a IAM.

Costi

In questo documento vengono utilizzati i seguenti componenti fatturabili di Google Cloud:

- BigQuery: ti vengono addebitati dei costi per i dati elaborati in BigQuery.

Per generare una stima dei costi in base all'utilizzo previsto,

utilizza il Calcolatore prezzi.

Per saperne di più, consulta la pagina relativa ai prezzi di BigQuery.

Prima di iniziare

- Accedi al tuo account Google Cloud. Se non conosci Google Cloud, crea un account per valutare le prestazioni dei nostri prodotti in scenari reali. I nuovi clienti ricevono anche 300 $di crediti gratuiti per l'esecuzione, il test e il deployment dei carichi di lavoro.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

-

Assicurati che la fatturazione sia attivata per il tuo progetto Google Cloud.

-

Attiva l'API BigQuery.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

-

Assicurati che la fatturazione sia attivata per il tuo progetto Google Cloud.

-

Attiva l'API BigQuery.

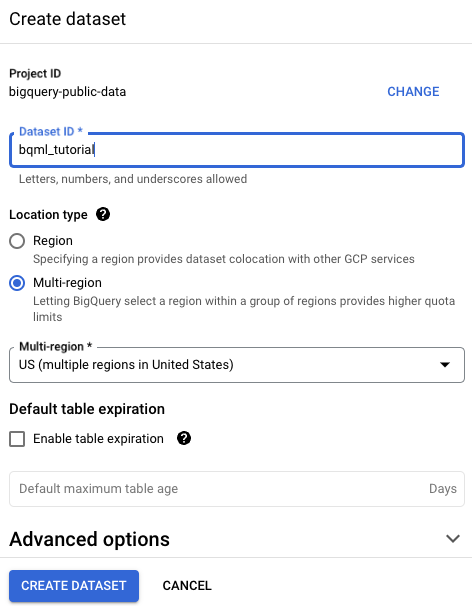

crea un set di dati

Crea un set di dati BigQuery per archiviare il tuo modello ML:

Nella console Google Cloud, vai alla pagina BigQuery.

Nel riquadro Explorer, fai clic sul nome del progetto.

Fai clic su Visualizza azioni > Crea set di dati.

Nella pagina Crea set di dati, segui questi passaggi:

In ID set di dati, inserisci

bqml_tutorial.Per Tipo di località, seleziona Più regioni e poi Stati Uniti (più regioni negli Stati Uniti).

I set di dati pubblici vengono archiviati in

USpiù regioni. Per semplicità, memorizza il set di dati nella stessa posizione.Lascia invariate le restanti impostazioni predefinite e fai clic su Crea set di dati.

prepara i dati di addestramento

I dati relativi a PM 2, 5, temperatura e velocità del vento sono riportati in tabelle separate.

Crea la tabella bqml_tutorial.seattle_air_quality_daily dei dati di addestramento

combinando i dati in queste tabelle pubbliche.

bqml_tutorial.seattle_air_quality_daily contiene le seguenti colonne:

date: la data dell'osservazionePM2.5: il valore medio di PM 2,5 per ogni giornowind_speed: velocità del vento media per ogni giornotemperature: la temperatura più alta di ogni giorno

La nuova tabella contiene i dati giornalieri dall'11 agosto 2009 al 31 gennaio 2022.

Vai alla pagina BigQuery.

Nel riquadro dell'editor SQL, esegui la seguente istruzione SQL:

CREATE TABLE `bqml_tutorial.seattle_air_quality_daily` AS WITH pm25_daily AS ( SELECT avg(arithmetic_mean) AS pm25, date_local AS date FROM `bigquery-public-data.epa_historical_air_quality.pm25_nonfrm_daily_summary` WHERE city_name = 'Seattle' AND parameter_name = 'Acceptable PM2.5 AQI & Speciation Mass' GROUP BY date_local ), wind_speed_daily AS ( SELECT avg(arithmetic_mean) AS wind_speed, date_local AS date FROM `bigquery-public-data.epa_historical_air_quality.wind_daily_summary` WHERE city_name = 'Seattle' AND parameter_name = 'Wind Speed - Resultant' GROUP BY date_local ), temperature_daily AS ( SELECT avg(first_max_value) AS temperature, date_local AS date FROM `bigquery-public-data.epa_historical_air_quality.temperature_daily_summary` WHERE city_name = 'Seattle' AND parameter_name = 'Outdoor Temperature' GROUP BY date_local ) SELECT pm25_daily.date AS date, pm25, wind_speed, temperature FROM pm25_daily JOIN wind_speed_daily USING (date) JOIN temperature_daily USING (date)

Crea il modello

Crea un modello di serie temporali multivariato, utilizzando i dati di

bqml_tutorial.seattle_air_quality_daily come dati di addestramento.

Vai alla pagina BigQuery.

Nel riquadro dell'editor SQL, esegui la seguente istruzione SQL:

CREATE OR REPLACE MODEL `bqml_tutorial.arimax_model` OPTIONS ( model_type = 'ARIMA_PLUS_XREG', auto_arima=TRUE, time_series_data_col = 'temperature', time_series_timestamp_col = 'date' ) AS SELECT * FROM `bqml_tutorial.seattle_air_quality_daily`;Il completamento della query richiede alcuni secondi, dopodiché il modello

arimax_modelviene visualizzato nel set di datibqml_tutorialnel riquadro Explorer.Poiché la query utilizza un'istruzione

CREATE MODELper creare un modello, non ci sono risultati della query.

Esegui il rilevamento di anomalie sui dati storici

Esegui il rilevamento di anomalie in base ai dati storici utilizzati per addestrare il modello.

Vai alla pagina BigQuery.

Nel riquadro dell'editor SQL, esegui la seguente istruzione SQL:

SELECT * FROM ML.DETECT_ANOMALIES ( MODEL `bqml_tutorial.arimax_model`, STRUCT(0.6 AS anomaly_prob_threshold) ) ORDER BY date ASC;

I risultati sono simili ai seguenti:

+-------------------------+-------------+------------+--------------------+--------------------+---------------------+ | date | temperature | is_anomaly | lower_bound | upper_bound | anomaly_probability | +--------------------------------------------------------------------------------------------------------------------+ | 2009-08-11 00:00:00 UTC | 70.1 | false | 67.65880237416745 | 72.541197625832538 | 0 | +--------------------------------------------------------------------------------------------------------------------+ | 2009-08-12 00:00:00 UTC | 73.4 | false | 71.715603233887791 | 76.597998485552878 | 0.20589853827304627 | +--------------------------------------------------------------------------------------------------------------------+ | 2009-08-13 00:00:00 UTC | 64.6 | true | 67.741606808079425 | 72.624002059744512 | 0.94627126678202522 | +-------------------------+-------------+------------+--------------------+--------------------+---------------------+

Esegui il rilevamento di anomalie sui nuovi dati

Esegui il rilevamento di anomalie in base ai dati storici utilizzati per addestrare il modello.

Vai alla pagina BigQuery.

Nel riquadro dell'editor SQL, esegui la seguente istruzione SQL:

SELECT * FROM ML.DETECT_ANOMALIES ( MODEL `bqml_tutorial.arimax_model`, STRUCT(0.6 AS anomaly_prob_threshold), ( SELECT * FROM UNNEST( [ STRUCT<date TIMESTAMP, pm25 FLOAT64, wind_speed FLOAT64, temperature FLOAT64> ('2023-02-01 00:00:00 UTC', 8.8166665, 1.6525, 44.0), ('2023-02-02 00:00:00 UTC', 11.8354165, 1.558333, 40.5), ('2023-02-03 00:00:00 UTC', 10.1395835, 1.6895835, 46.5), ('2023-02-04 00:00:00 UTC', 11.439583500000001, 2.0854165, 45.0), ('2023-02-05 00:00:00 UTC', 9.7208335, 1.7083335, 46.0), ('2023-02-06 00:00:00 UTC', 13.3020835, 2.23125, 43.5), ('2023-02-07 00:00:00 UTC', 5.7229165, 2.377083, 47.5), ('2023-02-08 00:00:00 UTC', 7.6291665, 2.24375, 44.5), ('2023-02-09 00:00:00 UTC', 8.5208335, 2.2541665, 40.5), ('2023-02-10 00:00:00 UTC', 9.9086955, 7.333335, 39.5) ] ) ) );I risultati sono simili ai seguenti:

+-------------------------+-------------+------------+--------------------+--------------------+---------------------+------------+------------+ | date | temperature | is_anomaly | lower_bound | upper_bound | anomaly_probability | pm25 | wind_speed | +----------------------------------------------------------------------------------------------------------------------------------------------+ | 2023-02-01 00:00:00 UTC | 44.0 | true | 36.917405956304407 | 41.79980120796948 | 0.890904731626234 | 8.8166665 | 1.6525 | +----------------------------------------------------------------------------------------------------------------------------------------------+ | 2023-02-02 00:00:00 UTC | 40.5 | false | 34.622436643607685 | 40.884690866417984 | 0.53985850962605064 | 11.8354165 | 1.558333 | +--------------------------------------------------------------------------------------------------------------------+-------------------------+ | 2023-02-03 00:00:00 UTC | 46.5 | true | 33.769587937313183 | 40.7478502941026 | 0.97434506593220793 | 10.1395835 | 1.6895835 | +-------------------------+-------------+------------+--------------------+--------------------+---------------------+-------------------------+

Esegui la pulizia

- Nella console Google Cloud, vai alla pagina Gestisci risorse.

- Nell'elenco dei progetti, seleziona il progetto che vuoi eliminare, quindi fai clic su Elimina.

- Nella finestra di dialogo, digita l'ID del progetto e fai clic su Chiudi per eliminare il progetto.